இந்த நாட்களில் ஒரு நல்ல டீப்ஃபேக்கை உருவாக்க இது அதிகம் தேவையில்லை, குறிப்பாக செயற்கை நுண்ணறிவு கருவிகள், ஒழுக்கமான கேமிங் கணினி மற்றும் அவர்கள் குளோன் செய்ய முயற்சிக்கும் நபரின் ஆடியோ மற்றும் வீடியோ மாதிரிகள் போன்றவற்றை யாராவது அணுகினால்.

மோசடி செய்பவர்கள் பெரும்பாலும் நிகழ்நேர வீடியோ மற்றும் ஆடியோ குளோன்களைப் பயன்படுத்தி, உயர் அதிகாரிக்கு பணத்தை மாற்றுவதாக நினைக்கும் நிறுவனங்களிலிருந்து, தங்கள் குழந்தை என்று நினைக்கும் ஒருவரிடமிருந்து உதவிக்காக அழைப்பைப் பெற்று பீதியில் பணம் அனுப்பும் பெற்றோர்கள் வரை அனைவரையும் மோசடி செய்கின்றனர்.

இப்போது பெருகிய முறையில் நம்பத்தகுந்த போலி வீடியோக்கள், சில சமூக ஊடகங்களில் மறுபதிவு செய்யப்பட்டு, டொனால்ட் டிரம்ப் மற்றும் எலோன் மஸ்க் போன்றவர்களால் பெருக்கப்படுகின்றன, நவம்பர் ஜனாதிபதித் தேர்தலுக்கு முன்னதாக அமெரிக்கர்களை ஸ்னூக்கர் செய்ய பயன்படுத்தப்படுகின்றன. இந்த டீப்ஃபேக்குகள் எப்படி அல்லது மக்கள் வாக்களித்தாலும் கூட பாதிக்கக்கூடும் என்று நிபுணர்கள் கவலைப்படுகிறார்கள்.

“இந்த விஷயங்களைப் பற்றி மக்களுக்குத் தெரியப்படுத்துவது முக்கியம், ஏனென்றால் தேர்தலுக்கு இன்னும் மூன்று மாதங்கள் உள்ளன, அது ஏற்கனவே நடந்து கொண்டிருக்கிறது” என்று சைபர் செக்யூரிட்டி நிறுவனமான பிஷப் ஃபாக்ஸின் மூத்த சிவப்பு குழுவான பிராண்டன் கோவாக்ஸ் கூறினார். ரெட் டீமர்கள், பாதுகாப்பு ஓட்டைகளைக் கண்டறிவதற்காக நிறுவனங்களைத் தாக்குவதன் மூலம் தங்கள் இணைய பாதுகாப்பை மேம்படுத்த உதவுகிறார்கள்.

தேர்தல் தவறான தகவல்கள், அரசியல்வாதிகள் அல்லது அமெரிக்காவின் எதிரிகளால் பரப்பப்பட்டாலும், அது ஒரு புதிய விஷயம் அல்ல. 2024 ஜனாதிபதிப் போட்டிக்கான புதிய விஷயம் என்னவென்றால், YouTube டுடோரியல்களுடன் முழுமையான திறந்த மூல AI- இயங்கும் கருவிகளின் எழுச்சி, இது யாரையும் நம்ப வைக்கும் ஆழமான போலிகளை உருவாக்கி, தவறான தகவல்களைப் பரப்புவதற்கு அவற்றைப் பயன்படுத்த அனுமதிக்கும்.

“நீங்கள் சில பைத்தியக்காரத்தனமான இரகசிய கருவிகளைப் பயன்படுத்துவது போல் இல்லை” என்று கோவாக்ஸ் கூறினார். “எல்லா பொருட்களும் வெளியே செல்ல தயாராக உள்ளன.”

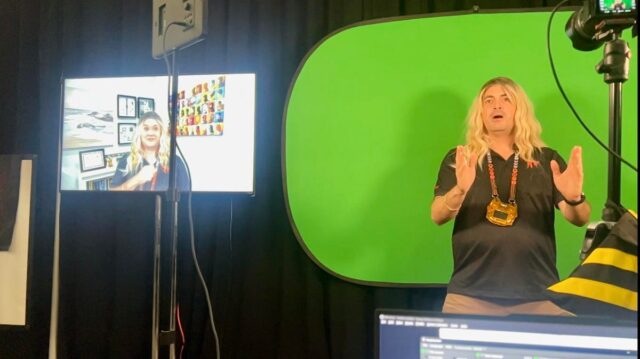

பிஷப் ஃபாக்ஸின் பிராண்டன் கோவாக்ஸ் ஒரு பெண் சக ஊழியராக தன்னை மாற்றிக் கொள்வதன் மூலம் ஒருவரை ஆழமாக்குவது எவ்வளவு எளிது என்பதை நிரூபிக்கிறது.

இந்த மாத தொடக்கத்தில் லாஸ் வேகாஸில் நடந்த டெஃப்கான் மாநாட்டில், போலி வீடியோக்களை உருவாக்குவது எவ்வளவு எளிது என்பதை AI வில்லேஜ் என்ற மாபெரும் நிகழ்வில் கோவாக்ஸ் நீண்ட வார இறுதியில் கழித்ததற்கு இதுவும் ஒரு பெரிய காரணம். வருடாந்திர கூட்டம் பல்லாயிரக்கணக்கான ஹேக்கர்கள் மற்றும் பிற இணைய பாதுகாப்பு நிபுணர்களை ஒன்றிணைக்கிறது.

ஒரு நுகர்வோர் நிலை கேமிங் லேப்டாப், அடிப்படை DSLR கேமரா, சில விளக்குகள் மற்றும் பச்சை திரை ஆகியவற்றைப் பயன்படுத்தி, Kovacs ஆர்வமுள்ள Defcon பங்கேற்பாளர்களை தனது குழுவில் உள்ள உயர்நிலை ஹேக்கர்கள் முதல் டிரம்ப், ஜாக்கி சான் மற்றும் கீனு ரீவ்ஸ் போன்ற பிரபலங்கள் வரை மாற்றினார்.

முடிவுகள் சரியாக இல்லை என்றாலும், முகத்தை மாற்றும் மென்பொருள் எவ்வளவு நன்றாக வேலை செய்தது என்பது ஆச்சரியமாக இருந்தது. பங்கேற்பாளர்கள் நிகழ்நேரத்தில் அவர்களுக்கு அடுத்துள்ள டிவி திரையில் அவர்கள் விரும்பும் ஆழமான நபராக மாற்றப்பட்டனர். அலுவலகம் அல்லது டிவி செய்தியறை போன்ற பின்னணிக் காட்சிகள் பச்சைத் திரையை மாற்றியது மற்றும் விக் போன்ற முட்டுக்கட்டைகள் மாற்றப்பட்ட முகத்தை வடிவமைக்க உதவியது மற்றும் ஒட்டுமொத்த படத்தை மிகவும் உறுதியானதாக மாற்றியமைக்கும் இயற்கையான இயக்கத்தின் கூறுகளைச் சேர்த்தது.

கலந்துகொண்டவர் நகர்ந்து பேசும்போது, ஆழமான படமும் இருந்தது. குரல்களும் நிகழ்நேரத்தில் குளோன் செய்யப்பட்டன, ஆனால் நிரம்பிய மாநாட்டு மையத்தில் கேட்க கடினமாக இருந்தது. வீடியோ தாமதம் அதிகம் இல்லை, மேலும் நுகர்வோர் தர மாதிரிக்குப் பதிலாக அதிக ஆற்றல் கொண்ட கணினியைப் பயன்படுத்துவது அவற்றைக் கணிசமாகக் குறைத்திருக்கும் என்று கோவாக்ஸ் கூறினார்.

டீப்ஃபேக்குகள் எவ்வளவு தூரம் வந்துள்ளன என்பதை மக்களுக்குத் தெரியப்படுத்துவதும், கணினி அமைப்புகளைப் பாதுகாப்பவர்கள் அவற்றைக் கண்டறிய சிறந்த மாதிரிகளை உருவாக்க உதவுவதும் ஆர்ப்பாட்டங்களின் குறிக்கோளாக இருந்தது. குறிப்பாக, டிஃபென்ஸ் அட்வான்ஸ்டு ரிசர்ச் ப்ராஜெக்ட்ஸ் ஏஜென்சி வேலை செய்து வரும் டீப்ஃபேக் கண்டறிதல் மாதிரியை ஊட்டுவதற்கு Kovacs இன் தரவு பயன்படுத்தப்படும்.

தவறான தகவல் என டீப்ஃபேக்குகள்

டீப்ஃபேக்குகள் நம்பத்தகுந்ததாக இருக்க அதிநவீனமானவையாக இருக்க வேண்டிய அவசியமில்லை, குறிப்பாக உயர்மட்ட நபர்களால் பரப்பப்பட்டால்.

டிரம்ப் சமீபத்தில் ஒரு புகைப்படத்தை வெளியிட்டார்குறைந்தபட்சம் சில AI-உருவாக்கப்பட்டதாகத் தோன்றியது, அவரது உண்மை சமூகக் கணக்கில் அவர் மெகாஸ்டார் டெய்லர் ஸ்விஃப்ட் மற்றும் அவரது ரசிகர்களால் அங்கீகரிக்கப்படுவதைக் குறிக்கிறது. “நான் ஏற்றுக்கொள்கிறேன்” என்ற வாசகத்துடன் அவர் முதலிடம் பிடித்த படங்கள் X இல் முதலில் வெளியிடப்பட்டதுமுன்பு ட்விட்டர் என்று அழைக்கப்பட்டது, ஒரு பயனரால் அவற்றை நையாண்டி என்று முத்திரை குத்தினார். டிரம்பின் ட்ரூத் சோஷியல் கணக்கில் மறுபதிவு செய்யப்பட்ட படங்களில் ஒன்று பட உரையில் “நையாண்டி” என்ற வார்த்தையும் உள்ளது.

மறுபுறம், டிரம்பும் உள்ளது துணை ஜனாதிபதி கமலா ஹாரிஸின் பிரச்சாரத்தில் பொய்யான குற்றச்சாட்டு டெட்ராய்ட் வெய்ன் கவுண்டி மெட்ரோபொலிட்டன் விமான நிலையத்தில் எடுக்கப்பட்ட புகைப்படத்தை ஆழமாக உருவாக்கி, அவர் இல்லை என்று கூறும் ஒரு பெரிய கூட்டத்தைக் காட்ட அதை “AI’d” என்று கூறினார். ஆனால் பல வீடியோக்கள் மற்றும் புகைப்படங்கள் இந்த நிகழ்வில் ஹாரிஸ் பிரச்சாரப் புகைப்படத்தில் காட்டப்பட்டுள்ளதைப் போன்ற அளவில் ஒரு கூட்டத்தைக் காட்டியது. நிகழ்வில் உள்ளூர் செய்தியாளர்கள் கூட்டம் சுமார் 15,000 பேர் என மதிப்பிட்டுள்ளனர்.

அதே ட்ரூத் சோஷியல் இடுகையில், ஜனநாயகக் கட்சியினரின் தேர்தல் மோசடி பற்றிய தனது தவறான கூற்றுகளையும் டிரம்ப் மீண்டும் வலியுறுத்தினார். அவர் பதவியில் இருந்து வாக்களிக்கப்பட்டு கிட்டத்தட்ட நான்கு ஆண்டுகளுக்குப் பிறகு, டிரம்ப் 2020 தேர்தல் மோசடி செய்யப்பட்டது என்ற பொய்யை தொடர்ந்து முன்வைக்கிறார், உண்மையான ஆதாரங்கள் எதுவும் காட்டப்படவில்லை.

டிரம்ப் பிரச்சாரம் மற்றும் ஸ்விஃப்ட் ஆகிய இரண்டின் பிரதிநிதிகள் கருத்து கேட்கும் மின்னஞ்சல்களுக்கு பதிலளிக்கவில்லை.

தனித்தனியாக, டிரம்பை ஆதரித்த எக்ஸ் தளத்தின் உரிமையாளரான எலோன் மஸ்க், ஜூலை மாதம் அவருக்குப் பிறகு வெந்நீரில் இறங்கினார். X க்கு ஒரு வீடியோவை இடுகையிட்டார் இது ஹாரிஸின் குரலைப் பிரதியெடுக்க குரல் குளோனிங் தொழில்நுட்பத்தைப் பயன்படுத்தியது, அவரது பிரச்சார வீடியோக்களில் ஒன்றின் காட்சிகளில் ஒரு ஆழமான குரல்வழியை உருவாக்கியது.

மஸ்க் இந்த இடுகையை நையாண்டி என்று முத்திரை குத்தவில்லை, ஆனால் விமர்சிக்கப்பட்ட பிறகு அதை தெளிவுபடுத்தினார்.

வேடிக்கையாக இருப்பது இன்னும் சரி, இல்லையா?

இது இரவு நேர பேச்சு நிகழ்ச்சி தொகுப்பாளர்களிடமிருந்து வந்தாலும் அல்லது இணையத்திலிருந்து வந்தாலும், நையாண்டி இல்லாத நவீன அமெரிக்க அரசியலை கற்பனை செய்வது கடினம், இது ஒப்புக்கொள்ளத்தக்கது, சில சமயங்களில் கவனக்குறைவாக மக்களுக்குத் தவறான தகவல்களைத் தருகிறது. ஆனால் டீப்ஃபேக்குகள் தங்கள் சொந்த லாபத்திற்காக தவறான தகவல்களைப் பரப்புவதற்கு வேண்டுமென்றே அவற்றைப் பயன்படுத்தும்போது விஷயங்களை ஒரு புதிய நிலைக்கு கொண்டு செல்ல முடியும்.

சைபர் செக்யூரிட்டி நிறுவனமான ஆர்க்டிக் வுல்ஃப்பின் தலைமை தகவல் பாதுகாப்பு அதிகாரி ஆடம் மார்ரே, அந்த டீப்ஃபேக்குகள் ஒப்பீட்டளவில் சிலரை திறம்பட நம்ப வைக்க வேண்டும் என்று கூறுகிறார்.

“மக்கள் தங்கள் ஊட்டங்களின் மூலம் ஸ்ட்ரீம் செய்யும்போது, அவர்கள் இதைப் பார்க்கப் போகிறார்கள், அவர்களில் சிலர் அவை டீப்ஃபேக்குகள் என்பதை புரிந்து கொள்ளாமல் இருக்கலாம் அல்லது அவர்கள் அதைப் பொருட்படுத்தாமல் இருக்கலாம்” என்று மார்ரே கூறினார். “அவை அனைத்தும் சில வழிகளில் கருத்தை வடிவமைக்கும்.”

அதனால்தான், சமூக ஊடக நிறுவனங்களும், AI நிறுவனங்களும், டீப்ஃபேக்குகளை சேதப்படுத்துவதற்குப் பின்னால் உள்ளவர்களை வெளியேற்றுவதற்கு தங்களால் இயன்றதைச் செய்வது மிகவும் முக்கியமானது என்று அவர் கூறுகிறார்.

“நான் இன்னும் கவலைப்படுகிறேன், இருப்பினும் நாங்கள் அவர்களின் நல்ல கருணையையும், ஒரு நல்ல குடிமகனாக இருக்க வேண்டும் என்ற அவர்களின் விருப்பத்தையும், அவர்கள் இதைச் செய்யச் சார்ந்து இருக்கிறோம்,” என்று அவர் கூறினார். “நாங்கள் பயன்படுத்தக்கூடிய எந்த ஒழுங்குமுறை அடிப்படையும் இல்லை, அல்லது கொள்கை வகுப்பாளர்கள் இதை செயல்படுத்த பயன்படுத்தலாம். அது எங்களுக்கு இன்னும் இல்லாத ஒன்று.”